การลงทุนที่เพิ่มขึ้นใน AI agents บ่งบอกถึงอนาคตของการใช้ระบบอัตโนมัติอย่างแพร่หลาย ซึ่งอาจเปลี่ยนแปลงมากกว่าการปฏิวัติอุตสาหกรรม เช่นเดียวกับนวัตกรรมทางเทคโนโลยีใดๆ AI agents ย่อมต้องเผชิญกับปัญหาในการพัฒนา การปรับปรุงอย่างต่อเนื่องจะเป็นสิ่งสำคัญสำหรับการใช้งานอย่างรับผิดชอบและการตระหนักถึงศักยภาพของ AI agents

ที่ Consensus ฮ่องกง BeInCrypto ได้สัมภาษณ์ Andrei Grachev Managing Partner ที่ DWF Labs เกี่ยวกับความท้าทายสำคัญที่ AI agents เผชิญในการบรรลุการยอมรับในวงกว้างและการใช้งานอย่างแพร่หลายจะมีลักษณะอย่างไร

ภาคเทคโนโลยีดั้งเดิมและ Web3 ยอมรับ AI

ในขณะนี้สามารถกล่าวได้ว่าการยอมรับปัญญาประดิษฐ์ AI จะหลีกเลี่ยงไม่ได้ในไม่ช้า บริษัทยักษ์ใหญ่ด้านเทคโนโลยีรวมถึง Meta Amazon Alphabet และ Microsoft ได้ประกาศแผนการลงทุนสูงถึง 320 พันล้านดอลลาร์ ใน AI และศูนย์ข้อมูลในปี 2025

ในสัปดาห์แรกที่ดำรงตำแหน่ง ประธานาธิบดีสหรัฐฯ Trump ได้ประกาศ Stargate ซึ่งเป็นการร่วมทุนเอกชนใหม่ ที่มุ่งเน้นการพัฒนาศูนย์ข้อมูล AI การร่วมทุนนี้ประกอบด้วย OpenAI Softbank และ Oracle วางแผนที่จะสร้างศูนย์ข้อมูล AI ขนาดใหญ่ถึง 20 แห่งทั่วสหรัฐอเมริกา

การลงทุนเริ่มต้นคาดว่าจะอยู่ที่ 100 พันล้านดอลลาร์ และแผนการขยายอาจทำให้ยอดรวมถึง 500 พันล้านดอลลาร์ ภายในปี 2029

โครงการ Web3 ก็ลงทุนใน AI เช่นกัน ในเดือนธันวาคม DWF Labs ซึ่งเป็นบริษัททุนร่วมลงทุนคริปโตชั้นนำ ได้เปิดตัวกองทุน AI agent มูลค่า 20 ล้านดอลลาร์ เพื่อเร่งนวัตกรรมในเทคโนโลยี AI อัตโนมัติ

เมื่อต้นเดือนนี้ NEAR Foundation ซึ่งสนับสนุน Protocol NEAR ก็ได้ประกาศกองทุน 20 ล้านดอลลาร์ ของตนเอง ที่มุ่งเน้นการขยายการพัฒนา agents ที่เป็นอัตโนมัติและตรวจสอบได้ซึ่งสร้างขึ้นบนเทคโนโลยี NEAR

ประวัติศาสตร์แสดงให้เห็นว่าทุกสิ่งที่สามารถทำให้เป็นอัตโนมัติได้จะถูกทำให้เป็นอัตโนมัติ และแน่นอนว่ากระบวนการทางธุรกิจและชีวิตปกติบางอย่างจะถูกครอบครองโดย AI agents Grachev กล่าวกับ BeInCrypto

แต่เมื่อการพัฒนา AI เร่งขึ้น ความเป็นไปได้ในการใช้งานในทางที่ผิดก็กลายเป็นความกังวลที่เพิ่มขึ้น

การใช้ AI Agents ในทางที่ไม่ดี

ใน Web3 AI agents กำลังกลายเป็นกระแสหลักอย่างรวดเร็ว พวกเขามีความสามารถหลากหลาย ตั้งแต่การวิเคราะห์ตลาดไปจนถึงการซื้อขายคริปโตอัตโนมัติ

อย่างไรก็ตาม การบูรณาการที่เพิ่มขึ้นของพวกเขาก็สร้างความท้าทายที่สำคัญ การใช้งาน AI ในทางที่ผิดโดยผู้ไม่หวังดีเป็นความกังวลหลัก ครอบคลุมสถานการณ์ตั้งแต่แคมเปญฟิชชิงง่ายๆ ไปจนถึงการโจมตีแรนซัมแวร์ที่ซับซ้อน

การมีอยู่ทั่วไปของ AI ที่สร้างเนื้อหาตั้งแต่ปลายปี 2022 ได้เปลี่ยนแปลงการสร้างเนื้อหาอย่างพื้นฐาน ในขณะเดียวกันก็ยังดึงดูดผู้ไม่หวังดีที่ต้องการใช้ประโยชน์จากเทคโนโลยีนี้ การทำให้พลังการคำนวณเป็นประชาธิปไตยนี้ได้เพิ่มความสามารถของฝ่ายตรงข้ามและอาจลดอุปสรรคในการเข้าถึงสำหรับผู้คุกคามที่มีความซับซ้อนน้อยกว่า

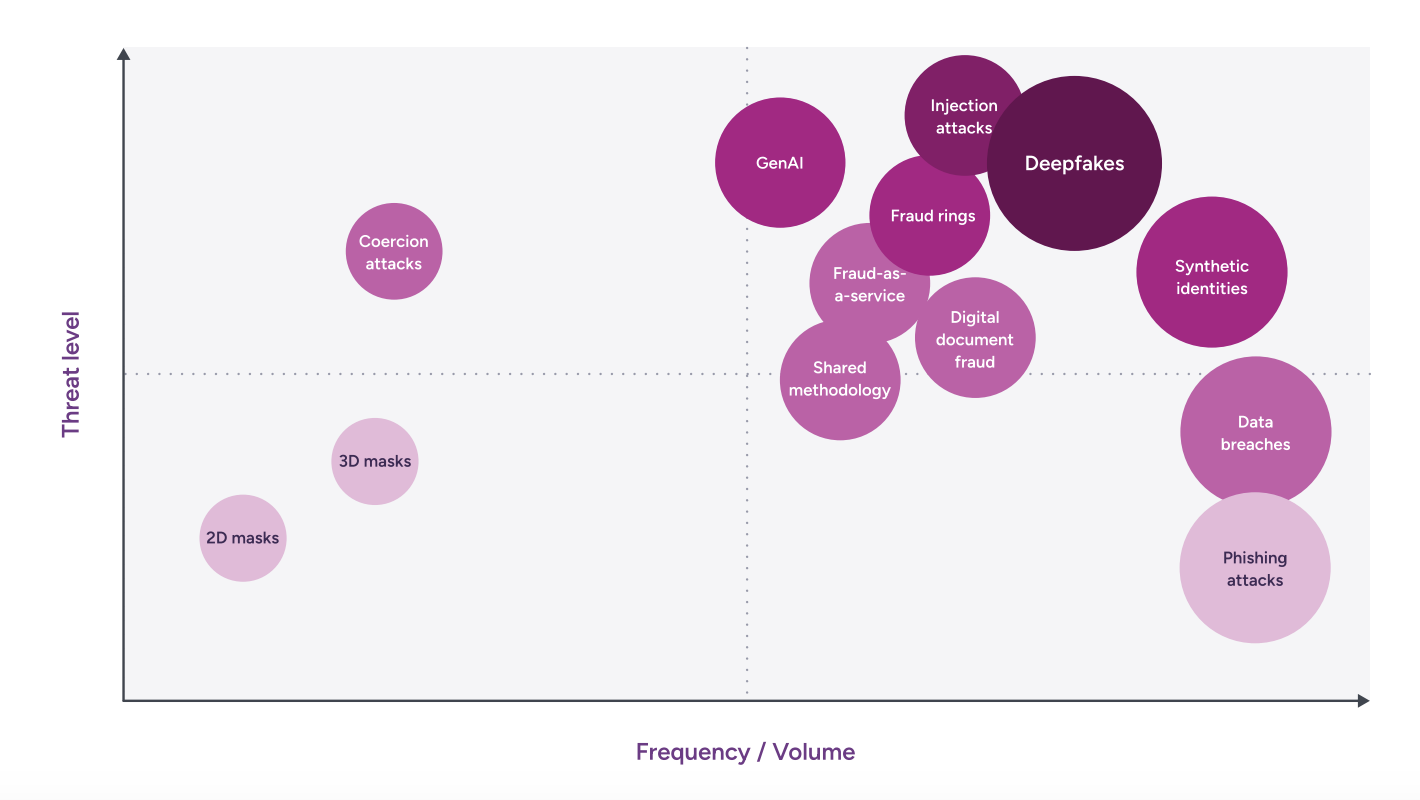

ตามรายงานของ Entrust รายงาน การปลอมแปลงเอกสารดิจิทัลที่ใช้เครื่องมือ AI มีจำนวนมากกว่าการปลอมแปลงทางกายภาพ โดยเพิ่มขึ้น 244% เมื่อเทียบกับปีที่ผ่านมาในปี 2024 ขณะเดียวกัน deepfakes คิดเป็น 40% ของการฉ้อโกงทางชีวมิติทั้งหมด

มันถูกใช้ในการหลอกลวงแล้ว ใช้ในการโทรวิดีโอเมื่อแสดงตัวตนผิดและเสียงผิด Grachev กล่าว

ตัวอย่างของการใช้ประโยชน์แบบนี้ได้ทำให้เป็นข่าวพาดหัวแล้ว เมื่อต้นเดือนนี้ พนักงานการเงินที่บริษัทข้ามชาติในฮ่องกงถูกหลอกให้อนุมัติการชำระเงิน 25 ล้านดอลลาร์ให้กับ ผู้ฉ้อโกงที่ใช้เทคโนโลยี deepfake

พนักงานเข้าร่วมการโทรวิดีโอกับบุคคลที่เขาเชื่อว่าเป็นเพื่อนร่วมงาน รวมถึงหัวหน้าฝ่ายการเงินของบริษัท แม้จะลังเลในตอนแรก แต่พนักงานก็ทำการชำระเงินหลังจากผู้เข้าร่วมคนอื่นๆ ดูและฟังดูเหมือนจริงตามรายงาน ต่อมาพบว่าผู้เข้าร่วมทั้งหมดเป็น การสร้าง deepfake

จากการยอมรับในช่วงแรกสู่การยอมรับในวงกว้าง

Grachev เชื่อว่าการใช้ในทางที่ผิดเช่นนี้เป็นสิ่งที่หลีกเลี่ยงไม่ได้ เขาชี้ให้เห็นว่าการพัฒนาเทคโนโลยีมักมาพร้อมกับข้อผิดพลาดในช่วงแรก ซึ่งจะลดลงเมื่อเทคโนโลยีเติบโตขึ้น Grachev ยกตัวอย่างสองกรณีเพื่อพิสูจน์ความคิดของเขา ช่วงเริ่มต้นของ World Wide Web และ Bitcoin

เราควรจำไว้ว่าการเริ่มต้นของอินเทอร์เน็ตมาจากเว็บไซต์โป๊ มันเหมือนกับ Bitcoin แรกที่เริ่มจากพ่อค้ายาและพัฒนาขึ้น Grachev กล่าว

หลายรายงานเห็นด้วยกับ Grachev พวกเขาแนะนำว่าอุตสาหกรรมบันเทิงสำหรับผู้ใหญ่มีบทบาทสำคัญในการยอมรับและพัฒนาอินเทอร์เน็ตในช่วงแรก นอกจากการเป็นฐานผู้บริโภคแล้ว ยังเป็นผู้บุกเบิกเทคโนโลยีเช่น VCRs การสตรีมวิดีโอ ความเป็นจริงเสมือน และการสื่อสารทุกรูปแบบ

สื่อลามกทำหน้าที่เป็นเครื่องมือในการนำผู้คนเข้าสู่เทคโนโลยีใหม่ อุตสาหกรรมบันเทิงสำหรับผู้ใหญ่มีประวัติในการขับเคลื่อนการยอมรับเทคโนโลยีใหม่ของผู้บริโภค

การยอมรับและการประยุกต์ใช้เทคโนโลยีใหม่ในช่วงแรก โดยเฉพาะเมื่อสามารถตอบสนองความต้องการของผู้ชมได้สำเร็จ มักนำไปสู่การยอมรับในวงกว้าง

มันเริ่มต้นด้วยความสนุก แต่ความสนุกได้นำผู้คนจำนวนมากเข้ามา จากนั้นคุณสามารถสร้างสิ่งต่างๆ บนผู้ชมนี้ Grachev กล่าว

เมื่อเวลาผ่านไป มาตรการป้องกันก็ถูกนำมาใช้เพื่อจำกัดความถี่และการเข้าถึงของความบันเทิงสำหรับผู้ใหญ่ อย่างไรก็ตาม มันยังคงเป็นหนึ่งในหลายบริการที่อินเทอร์เน็ตให้บริการในปัจจุบัน

การเดินทางของ Bitcoin จาก Darknet สู่การเปลี่ยนแปลง

การพัฒนาของ Bitcoin สะท้อนถึงการใช้งานแรกเริ่มของอินเทอร์เน็ตอย่างใกล้ชิด การยอมรับ Bitcoin ในช่วงแรกมีความเกี่ยวข้องอย่างมากกับตลาดมืดและกิจกรรมผิดกฎหมาย รวมถึงการค้ายาเสพติด การฉ้อโกง และการฟอกเงิน ลักษณะการใช้งานที่ไม่ระบุตัวตนและความสะดวกในการโอนเงินทั่วโลกทำให้มันน่าสนใจสำหรับอาชญากร

แม้จะยังคงถูกใช้ในกิจกรรมอาชญากรรม Bitcoin ก็ได้พบการใช้งานที่ถูกต้องตามกฎหมายมากมาย เทคโนโลยี Blockchain ที่เป็นพื้นฐานของสกุลเงินดิจิทัลให้วิธีแก้ปัญหาสำหรับปัญหาในโลกจริงและเปลี่ยนแปลงระบบการเงินแบบดั้งเดิม

แม้ว่าจะยังเป็นอุตสาหกรรมที่ยังใหม่มาก การใช้งานสกุลเงินดิจิทัลและบล็อกเชนจะยังคงพัฒนาไปเรื่อยๆ ตามที่ Garchev กล่าวไว้ การใช้เทคโนโลยี AI ก็จะค่อยๆ เกิดขึ้นเช่นกัน สำหรับเขา ความผิดพลาดต้องได้รับการยอมรับเพื่อเรียนรู้และปรับปรุงตามนั้น

เราควรจำไว้เสมอว่าการฉ้อโกงเกิดขึ้นก่อนแล้วคนถึงจะเริ่มคิดว่าจะป้องกันอย่างไร แน่นอนว่ามันจะเกิดขึ้น แต่มันเป็นกระบวนการปกติ เป็นการเรียนรู้ Grachev กล่าว

อย่างไรก็ตาม การรู้ว่าสถานการณ์เหล่านี้จะเกิดขึ้นในอนาคตก็ทำให้เกิดคำถามว่าใครควรรับผิดชอบ

ข้อกังวลด้านความรับผิดชอบ

การกำหนดความรับผิดชอบเมื่อเกิดความเสียหายจากการกระทำของตัวแทนเป็นปัญหาทางกฎหมายและจริยธรรมที่ซับซ้อน คำถามเกี่ยวกับวิธีการถือ AI รับผิดชอบย่อมเกิดขึ้น

ความซับซ้อนของระบบ AI สร้างความท้าทายในการกำหนดความรับผิดชอบต่อความเสียหาย ลักษณะกล่องดำพฤติกรรมที่ไม่สามารถคาดเดาได้ และความสามารถในการเรียนรู้ต่อเนื่องทำให้ยากที่จะใช้แนวคิดทั่วไปเกี่ยวกับใครเป็นผู้ผิดเมื่อเกิดปัญหา

นอกจากนี้ การมีส่วนร่วมของหลายฝ่ายในการพัฒนาและการใช้งาน AI ทำให้การประเมินความรับผิดชอบซับซ้อนขึ้น ทำให้ยากที่จะกำหนดความผิดพลาดของ AI

ความรับผิดชอบอาจอยู่ที่ผู้ผลิตสำหรับข้อบกพร่องในการออกแบบหรือการผลิต นักพัฒนาซอฟต์แวร์สำหรับปัญหาในโค้ด หรือผู้ใช้สำหรับการไม่ปฏิบัติตามคำแนะนำ การติดตั้งอัปเดต หรือการรักษาความปลอดภัย

ผมคิดว่าทุกอย่างยังใหม่มาก และผมคิดว่าเราควรเรียนรู้จากมัน เราควรหยุด AI บางตัวถ้าจำเป็น แต่จากมุมมองของผม ถ้าไม่มีเจตนาร้ายในการสร้างมัน ไม่มีใครต้องรับผิดชอบเพราะมันเป็นสิ่งใหม่จริงๆ Grachev กล่าวกับ BeInCrypto

อย่างไรก็ตาม ตามที่เขากล่าว สถานการณ์เหล่านี้ต้องได้รับการจัดการอย่างระมัดระวังเพื่อหลีกเลี่ยงผลกระทบต่อการนวัตกรรมอย่างต่อเนื่อง

ถ้าคุณตำหนินักธุรกิจคนนี้ มันจะฆ่านวัตกรรมเพราะผู้คนจะกลัว แต่ถ้ามันทำงานในทางที่ไม่ดี มันอาจจะทำงานได้ในที่สุด เราต้องมีวิธีหยุดมัน เรียนรู้ ปรับปรุง และเรียนรู้ใหม่ Grachev กล่าวเสริม

อย่างไรก็ตาม เส้นแบ่งที่ละเอียดอ่อนนี้ยังคงบางเฉียบ โดยเฉพาะในสถานการณ์ที่รุนแรงมากขึ้น

การแก้ไขปัญหาความเชื่อมั่นเพื่อการนำ AI ไปใช้ที่รับผิดชอบ

ความกลัวที่พบบ่อยเมื่อพูดถึงอนาคตของปัญญาประดิษฐ์คือสถานการณ์ที่ AI มีอำนาจมากกว่ามนุษย์

มีภาพยนตร์มากมายเกี่ยวกับเรื่องนี้ ถ้าเราพูดถึงการควบคุมของตำรวจหรือรัฐบาล หรือกองทัพในสงครามบางประเภท แน่นอนว่าการทำงานอัตโนมัติเป็นสิ่งที่น่ากลัว บางสิ่งสามารถทำงานอัตโนมัติในระดับที่ใหญ่จนสามารถทำร้ายมนุษย์ได้ Grachev กล่าว

เมื่อถูกถามว่าสถานการณ์เช่นนี้อาจเกิดขึ้นได้หรือไม่ Grachev กล่าวว่าทางทฤษฎีมันอาจจะเกิดขึ้นได้ อย่างไรก็ตาม เขายอมรับว่าเขาไม่สามารถรู้ได้ว่าจะเกิดอะไรขึ้นในอนาคต

อย่างไรก็ตาม สถานการณ์เช่นนี้เป็นตัวอย่างของปัญหาความไว้วางใจพื้นฐานระหว่างมนุษย์และปัญญาประดิษฐ์ Grachev กล่าวว่า วิธีที่ดีที่สุดในการแก้ปัญหานี้คือการเปิดโอกาสให้มนุษย์ได้ใช้ AI ในกรณีที่สามารถเป็นประโยชน์ได้จริง

AI อาจเป็นเรื่องยากสำหรับคนที่จะเชื่อ นั่นคือเหตุผลที่ควรเริ่มต้นด้วยสิ่งที่ง่าย เพราะความไว้วางใจใน AI จะไม่เกิดขึ้นเมื่อมีคนอธิบายว่ามันน่าเชื่อถือ ผู้คนควรคุ้นเคยกับการใช้งานมัน ตัวอย่างเช่น ถ้าคุณพูดถึงคริปโต คุณสามารถเปิดตัว Meme บน Pump.fun แต่ทำไมไม่เปิดตัวด้วยข้อความเสียง ด้วย AI เพียงแค่ส่งข้อความเสียงที่บอกว่า กรุณาเปิดตัวสิ่งนี้และสิ่งนั้น และมันก็เปิดตัว จากนั้นขั้นตอนต่อไปคือการไว้วางใจ AI ในการตัดสินใจที่สำคัญมากขึ้น เขากล่าว

ในที่สุด การเดินทางสู่การยอมรับ AI อย่างแพร่หลายจะถูกทำเครื่องหมายด้วยความก้าวหน้าที่น่าทึ่งและความท้าทายที่ไม่คาดคิด

การสร้างสมดุลระหว่างนวัตกรรมกับการดำเนินการอย่างรับผิดชอบในภาคส่วนที่กำลังพัฒนานี้จะมีความสำคัญต่อการสร้างอนาคตที่ AI เป็นประโยชน์ต่อมนุษยชาติทั้งหมด