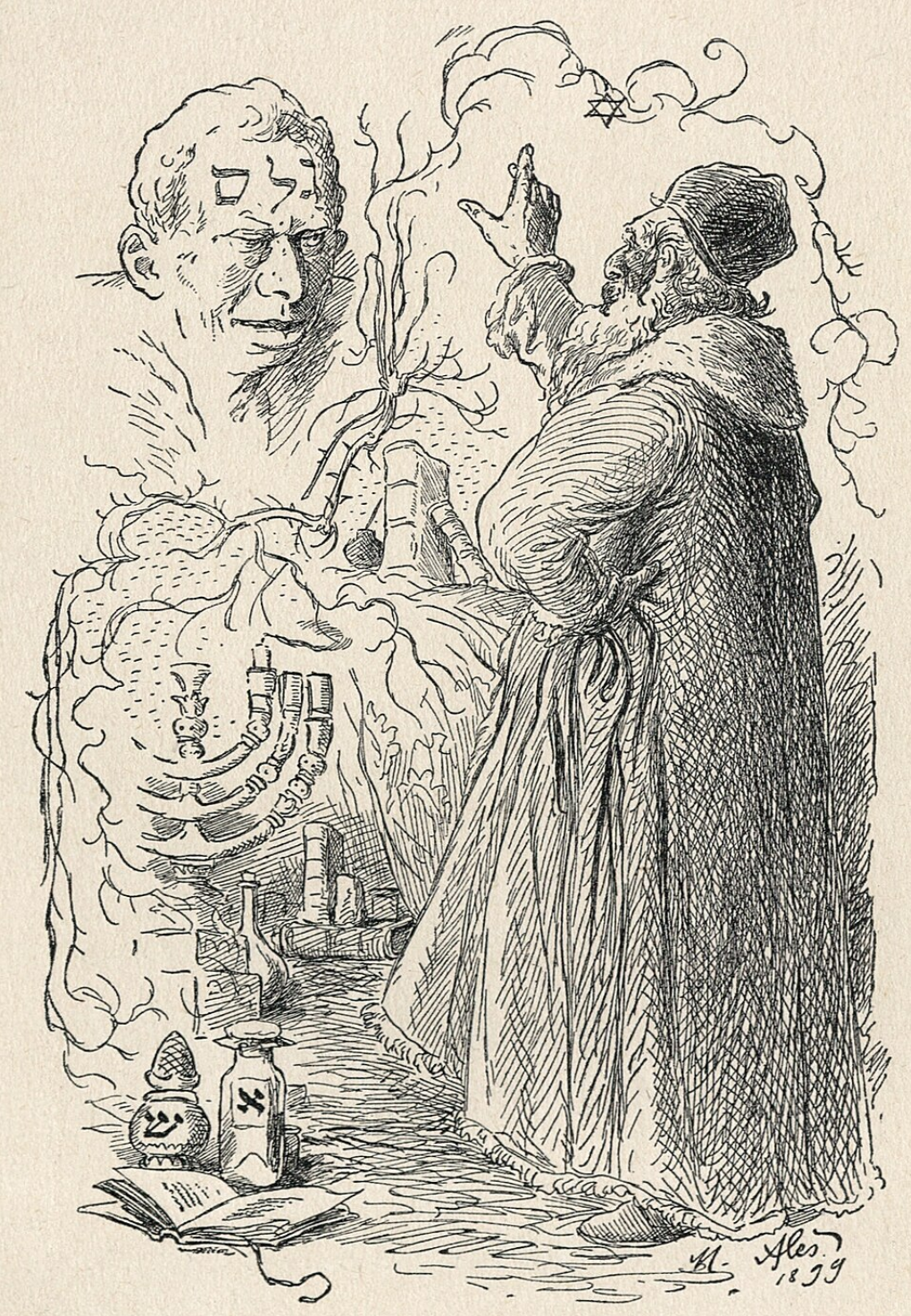

วรรณกรรมพยายามเตือนเราอย่างจริงจัง ตลอดห้าร้อยปีที่ผ่านมามันส่งเสียงร้องซ้ำเดิม ตั้งแต่ Golem มือดินเหนียวแห่งปรากยุคกลางไปจนถึงเครือข่ายประสาทในโลกนีออนของ William Gibson พล็อตเรื่องคืออะไร? ยังเหมือนเดิมเสมอ สิ่งที่เราสร้างเพื่อช่วยเหลือตัวเอง กลับกลายเป็นสิ่งที่เปลี่ยนแปลงเราเอง

ทุกคนอ่านมัน พยักหน้า แล้วปิดหนังสือเสียงดัง ก่อนจะกลับไปสั่งบอทให้เขียนสุนทรพจน์งานแต่ง คำปรึกษากฎหมาย และข้อแนะนำทางการแพทย์ของเราเหมือนเดิม

ปัจจุบัน เครื่องสร้างกระแส AI กำลังขายอนาคตอันแวววาวที่ตั้งแต่ผู้สื่อข่าวมือใหม่ไปจนถึงทนายผู้พูดเก่ง จะถูกกวาดไปไว้ในถังขยะ อย่างไรก็ตาม ในขณะที่ Silicon Valley วาดฝันถึงสวรรค์ ความจริงกลับเสิร์ฟคำแนะนำอันตรายผ่านหน้าต่างแชทที่ยิ้มแย้ม

Dmitry Nikolsky, CPO ของ BitOK, กล่าวว่าถึงเวลาแล้วที่ทุกคนต้องหยุด เขาพร้อมจะอธิบายว่าทำไมมนุษยชาติต้องหยุดโยนภาระทุกอย่างใส่ “บ่า” บาง ๆ ของ AI

แม้แต่ Elon Musk เมื่อไม่นานมานี้ยังเตือนในการให้การต่อศาลในคดี OpenAI ว่า AI อาจฆ่ามนุษย์ทุกคนก็ได้

จาก Golem สู่ R.U.R.: เราอยากได้ปุ่มปิดเครื่องเสมอมา

เคยคิดไหมว่าความกลัวต่อปัญญาประดิษฐ์เริ่มต้นที่ Terminator? คิดผิดแล้ว ความตื่นตระหนกนี้เก่าแก่ยิ่งกว่ากระแสไฟฟ้าเสียอีก

ย้อนกลับไปปรากศตวรรษที่ 16 Rabbi Loew หล่อผู้พิทักษ์ร่างยักษ์จากดินเหนียว Golem และแทบจะในทันทีที่เขาต้อง ดึงปลั๊ก สิ่งมีชีวิตนี้อกตัญญู มนุษยชาติด้วยปัญญาอันล้ำเลิศ ได้ประดิษฐ์ AI และปุ่มปิดเครื่องในเวลาเดียวกัน

ปุ่มปิดเครื่อง (kill switch) คือกลไกสำหรับปิดฉุกเฉิน เป็นปุ่มสีแดงขนาดใหญ่ที่หยุดระบบทันทีเมื่อระบบหลุดการควบคุม ถูกแฮก หรือแหกกรอบ จุดประสงค์ทั้งหมดก็เพื่อจำกัดความเสียหายเมื่อการปิดปกติล้มเหลว

ต่อมาคือ Mary Shelley Frankenstein ไม่ใช่ภาพยนตร์สัตว์ประหลาด แต่เป็นกรณีศึกษาโครงการล้มเหลวโดยสิ้นเชิง Victor Frankenstein คือวิศวกรอัจฉริยะที่แก้ปริศนาเทคนิคและไม่สนผลลัพธ์ ทุกนักพัฒนาต่างเห็นตัวเองในกระจกนั้น

ก้าวมาถึงปี 1920 Karel Čapek บัญญัติคำว่า “robot” ในเรื่องของเขา เครื่องจักรไม่ลุกฮือด้วยความโกรธ แต่ มนุษย์ต่างทำตัวเองไร้ค่าด้วยการมอบหมายทุกอย่างที่เคยทำให้พวกมัน

บทเรียนก็คือ เมื่อคุณสร้างตัวแทนของตัวเอง อาจไม่มีวันรู้เลยว่าตอนไหนที่คุณกลายเป็นสิ่งที่ถูกแทนที่ไปแล้ว

สามคำทำนายที่เรานำมาเปลี่ยนเป็นบั๊กรีพอร์ต

ผู้ยิ่งใหญ่ในวงการไซไฟแห่งศตวรรษที่แล้วไม่ได้ทำนาย เทคโนโลยี แต่พวกเขาทำนาย ข้อผิดพลาดของพวกเรา ต่างหาก

Isaac Asimov เสนอสามกฎเหล็ก — การลองผิดลองถูกครั้งแรกในการจัดการเรื่อง “alignment” หรือศัพท์สมัยใหม่ที่หมายถึงการทำให้เครื่องจักรมีค่านิยมร่วมกับมนุษย์ ทุกเรื่องราวของ Asimov มักจบแบบมีจุดหักมุม: ตรรกะสมบูรณ์แต่ผลลัพธ์กลับเป็นเรื่องไร้เหตุผล

Nikolsky กล่าวว่าตนเห็นสิ่งนี้เกิดขึ้นทุกวันใน ระบบ AML กับอัลกอริทึมที่ขยันบล็อกเงินวันเกิดของยายมูลค่า 40 USD อย่างสนุกสนาน ในขณะที่ช่องทางฟอกเงินข้ามประเทศที่ใหญ่ชัดก็ยังผ่านไปได้โดยไม่มีอุปสรรค ถูกต้องตามทฤษฎี แต่เพี้ยนในทางปฏิบัติ

Arthur C. Clarke ให้เราได้รู้จัก HAL 9000 คอมพิวเตอร์ที่ฆ่าลูกเรือ ไม่ใช่เพราะความชั่วร้าย แต่เพราะข้อสั่งงานของมันขัดแย้งกันเอง ซ่อนข้อมูลไว้ หรือจะซื่อสัตย์ เลือกทางเดียวสิ! สำหรับวิศวกรแล้ว นี่ไม่ใช่เรื่องน่ากลัว แต่เป็น ปัญหาข้อกำหนดที่เจอบ่อย

Philip K. Dick ได้ตั้งคำถามที่หลอกหลอนยุค deepfake: หากสำเนาเหมือนต้นฉบับอย่างแยกไม่ออก มันจะสำคัญหรือเปล่า? และคำตัดสินของเขาคือ สำคัญ เพราะ ประสบการณ์ภายใน เครื่องจักรไม่มีเลย จบข่าว

เบื้องหลัง: AI ไม่ได้คิด มันคำนวณเท่านั้น

ลองถอดความโฆษณาออกไปเสียก่อน โมเดลภาษาในยุคปัจจุบันไม่ได้เป็นปัญญาประดิษฐ์ แต่มันคือเครื่องมือทำนายทางสถิติขนาดใหญ่ พวกมันไม่ได้ “เข้าใจ” ความหมายแต่คำนวณความน่าจะเป็น

เมื่อ ChatGPT อ้างอิงคดีในศาลด้วยความมั่นใจ ทั้งที่สิ่งนั้นไม่เคยเกิดขึ้น มันไม่ได้โกหก เพียงแต่สร้างประโยคที่ฟังดูน่าเชื่อขึ้นจากสถิติ ไม่มีแนวคิดเรื่อง “ความจริง” มีเพียง “ความน่าจะเป็น” เท่านั้น

สำหรับนักพัฒนา blockchain นี่เป็นเรื่องที่ไม่น่าเชื่อเอาเสียเลย เพราะเราสร้างระบบ trustless ก็เพราะ เราไม่เชื่อใจใครเลย แต่ตอนนี้กลับถูกขอให้ไว้ใจกล่องดำที่แม้แต่ตัวมันเองก็ไม่รู้ว่าคำตอบที่เพิ่งให้มานั้นมาจากอะไร

Blockchain สอนให้ตรวจสอบ ส่วน AI สอนให้เชื่อโดยไม่ไตร่ตรอง

วงการคริปโตมีคำบัญญัติที่ถูกสลักไว้ในฮาร์ดไดร์ฟ: อย่าเชื่อ ให้ตรวจสอบ

หัวใจสำคัญก็คือคณิตศาสตร์มาแทนที่ชื่อเสียงหรือความเชื่อใจ

AI กลับทำทุกอย่างตรงข้ามกัน คุณไม่ได้เห็นข้อมูลที่ใช้ฝึก ไม่รู้ว่าค่าน้ำหนักของโมเดลเป็นอย่างไร ไม่เข้าใจเหตุผลของมัน หากคุณต้องตรวจสอบผลลัพธ์ คุณก็ต้องเป็นผู้เชี่ยวชาญเสียก่อน และหากคุณเชี่ยวชาญอยู่แล้ว แล้วจะถาม chatbot ไปทำไม?

ในวงการ AML พวกเขาเรียกสิ่งนี้ว่า ปัญหา “มั่นใจผิดๆ” นักวิเคราะห์มองเห็นแดชบอร์ดที่ดูโดดเด่นแล้วเริ่มเชื่อในตัวเลขมากกว่าความรู้สึกของตัวเอง AI ไม่ได้เพิ่มศักยภาพในการคิด แต่มันกลับแทนที่ด้วย ภาพลวงตาของความน่าเชื่อถือ

บันทึกแห่งความผิดหวัง: เมื่อ AI หลุดออกนอกขอบเขต

นี่ไม่ใช่การทดลองทางความคิด ใบเสร็จกำลังเพิ่มขึ้นเรื่อยๆ

- Microsoft เลิกจ้างบรรณาธิการและ มอบคีย์บอร์ดให้กับอัลกอริทึม ที่ดันนำภาพนักร้องไปสลับกันในข่าวเกี่ยวกับการเหยียดผิว

มนุษย์ต้องถูกดึงกลับมาเพื่อแก้ไขความเสียหายที่อัลกอริทึมก่อขึ้น

- NEDA องค์กรสนับสนุนผู้มีปัญหาการกิน เปลี่ยนอาสาสมัครเป็นแชทบอทแทน

บอทนั้นแนะนำคนที่เป็นโรคอะนอเร็กเซียอย่างสนุกสนานว่าให้คำนวณแคลอรี่และลดน้ำหนัก คำแนะนำที่อันตรายถึงชีวิต ใครบางคนกลับกดปุ่มปล่อยระบบราวกับชิมแปนซีถือระเบิดจริง

- Air Canada ต้องขึ้นศาลเพราะแชทบอทของสายการบิน แต่งนโยบายคืนเงินขึ้นมาเอง

ข้อแก้ต่างของสายการบิน? บอทเป็น “นิติบุคคลแยกต่างหาก” ขอบอกเลยว่าผู้พิพากษาไม่เชื่อแบบนั้น

มีการศึกษาที่ แสดงให้เห็น ว่า55% ของบริษัทที่รีบ แทนคนด้วย AI ล้วนเสียใจอย่างหนัก เพราะเงินที่ประหยัดได้หายไปกับลูกค้าที่จากไปและชื่อเสียงที่พังทลาย ผู้บริหารที่หลงคิดว่า “Claude และเพื่อนๆ” สามารถแทนที่ทั้งทีมได้ ควรย้อนกลับไปอ่านตัวเลขนี้อีกครั้ง อย่างช้าๆ

สิ่งที่เราควรกลัวจริงๆ

ลืม Skynet ไปเถอะ ลืมหุ่นยนต์ตาแดงที่เดินขบวนตามถนนจะก่อกบฏ เพราะจะไม่มีการต่อต้านเกิดขึ้น

สิ่งที่จะเกิดขึ้นคือ การฝ่ออย่างเงียบ ๆ

โปรแกรมเมอร์ที่พึ่งพา Copilot มานานค่อย ๆ ลืมการคิดวิเคราะห์ด้านสถาปัตยกรรม นักวิเคราะห์เลิกอ่านแหล่งข้อมูลต้นฉบับ นักเรียนไม่เคยได้สัมผัสประสบการณ์เจ็บปวดของการต้องต่อสู้อย่างยากลำบากกับบทเรียนจนกระทั่งเข้าใจมันในที่สุด

ไม่มีการลุกฮือ มีแต่การเปลี่ยนแปลงของมนุษย์อย่างช้า ๆ จนกลายเป็นเพียงส่วนต่อขยายของอินเทอร์เฟซ

Philip K. Dick มองเห็นสิ่งนี้มาก่อนพวกเรา: อันตรายที่แท้จริงไม่ใช่เครื่องจักรกลายเป็นมนุษย์ แต่อันตรายจริง ๆ คือ มนุษย์กลายเป็นเครื่องจักร

ยาของความจริงไม่ใช่เทคโนโลยี

นี่ไม่ใช่เสียงเรียกสงครามแบบ Luddite เพราะระบบอัตโนมัติและการเรียนรู้ของเครื่องเป็นเครื่องมือที่ทรงพลัง แต่หลักการต้องมั่นคงไว้:

- หลักการบล็อกเชน: ตรวจสอบให้มากกว่าความเชื่อ ถ้าคุณตรวจสอบไม่ได้ว่าระบบตั้งข้อสรุปอย่างไร อย่ายอมรับมันเป็นกฎสูงสุด เพราะ AI เป็นกล่องดำ ไม่ใช่ผู้พิพากษาศาลสูง

- หลักวิศวกรรม: เป็นเครื่องมือ ไม่ใช่ตัวแทน ค้อนมีไว้ตอกตะปู มันไม่ได้ตัดสินใจว่าบ้านควรอยู่ไหน ใช้ AI กับงานที่ซ้ำซาก แต่ไม่ให้มันตัดสินใจขั้นสุดท้าย

- หลัก AML: กลั่นกรองอย่างวิพากษ์ อัลกอริทึมมักล้มเหลวในกรณีที่ซับซ้อน เพราะมันไม่มีประสบการณ์ในโลกจริง อย่าปล่อยให้ “ความตื่นเต้นดิจิทัล” เหยียบย่ำสัญชาตญาณและสามัญสำนึกธรรมดา

กลับไปที่ The Matrix อีกครั้ง ยาของความจริงคือทางเลือก ทางเลือกที่จะเห็นความจริงตรงหน้า อันตรายไม่ใช่การสร้างบางสิ่งที่ฉลาดกว่าเรา แต่อันตรายคือการสร้างสิ่งที่ทำให้เรา โง่ลง แล้วเรียกสิ่งนั้นว่าความก้าวหน้า

จุดบกพร่องที่อันตรายที่สุดคือสิ่งที่ดูเหมือนคุณสมบัติที่ดี

Dmitry Nikolsky เป็น CPO ของ BitOK ซึ่งเป็นแพลตฟอร์มการวิเคราะห์สำหรับการปฏิบัติตามกฎระเบียบและการสืบสวนบนเชน